Ferramentas de Raspagem da Web - Explicado

Nikolai Smirnov

Software Development Lead

TL;DR

- O web scraping automatiza a extração de dados de sites, transformando grandes volumes de dados online não estruturados em formatos estruturados e utilizáveis.

- É amplamente utilizado em diversas indústrias para monitoramento de preços, geração de leads, rastreamento de SEO, análise de sentimentos e jornalismo de dados.

- As ferramentas de web scraping se dividem em três categorias principais: ferramentas de autoatendimento sem código, ferramentas programáticas baseadas em código e serviços de extração de dados totalmente gerenciados.

- Ferramentas sem código e visuais (como Import.io, Octoparse, ParseHub, WebHarvy) são ideais para usuários não técnicos que precisam de resultados rápidos.

- Ferramentas e bibliotecas focadas em desenvolvedores (como Scrapy, BeautifulSoup, Selenium, Puppeteer, Cheerio) oferecem maior flexibilidade e escalabilidade, mas exigem conhecimentos de programação.

- Ferramentas de automação de navegador, como Selenium e Puppeteer, são essenciais para sites com muita JavaScript e altamente interativos.

- Escolher a ferramenta certa depende de sua expertise técnica, complexidade dos dados, escala e orçamento, em vez de uma abordagem "um tamanho se encaixa a todos".

- O web scraping responsável é crítico — sempre siga os termos de serviço do site e as diretrizes legais e éticas aplicáveis.

Ferramentas de Web Scraping

Web scraping, também conhecido como extração de dados da web, é o processo de recuperação ou "raspagem" de dados de um site. Ao contrário do processo monótono e cansativo de extrair dados manualmente, o web scraping usa automação inteligente para recuperar centenas, milhões ou até bilhões de pontos de dados da fronteira aparentemente infinita da internet.

O volume de dados na internet está crescendo exponencialmente. Existem mais de 1,7 bilhão de sites online, e mais são criados todos os dias. Nesse oceano de dados, como os negócios, pesquisadores e indivíduos podem esperar encontrar as informações de que precisam? A resposta está no web scraping.

Este guia visa fornecer uma visão aprofundada de algumas das ferramentas de web scraping mais poderosas disponíveis hoje. Embora algumas dessas ferramentas exijam um nível de conhecimento técnico, outras são adequadas para não programadores. Seja você um cientista de dados experiente, um desenvolvedor de software ou um especialista em marketing digital, encontrará uma ferramenta que atenda às suas necessidades.

Resgate seu código promocional da CapSolver

Aumente seu orçamento de automação instantaneamente!

Use o código promocional CAPN ao recarregar sua conta da CapSolver para obter um bônus adicional de 5% em cada recarga — sem limites.

Resgate-o agora em seu Painel da CapSolver

.

1. Introdução ao Web Scraping

O web scraping é um método automatizado usado para extrair grandes quantidades de dados de sites rapidamente. Os dados em sites são não estruturados. O web scraping permite que convertamos esses dados em uma forma estruturada.

2. Por que usar ferramentas de web scraping?

Existem inúmeras razões pelas quais empresas, acadêmicos e indivíduos podem querer raspar um site. Alguns usos comuns incluem:

- Jornalismo de dados: Jornalistas e pesquisadores podem usar ferramentas de web scraping para acompanhar mudanças em registros públicos ou coletar informações de várias fontes para uma reportagem investigativa.

- Comparação de preços: Empresas de comércio eletrônico usam frequentemente ferramentas de web scraping para monitorar as estratégias de preços de seus concorrentes. Ao raspar preços e descrições de produtos, elas mantêm o pulso no mercado.

- Geração de leads: Muitas empresas usam web scraping para gerar leads e coletar informações de contato de diretórios de empresas ou sites de redes sociais.

- Análise de sentimentos: Ao raspar avaliações de clientes e conversas nas redes sociais, as empresas podem obter insights sobre como seus produtos são percebidos no mercado, permitindo que reajam ao feedback dos clientes de forma mais eficaz.

- Monitoramento de SEO: Empresas de SEO usam raspadores de web para monitorar o desempenho de sites, rastrear mudanças nos rankings de SEO e coletar outros dados relevantes.

3. Tipos de Ferramentas de Web Scraping

Existem principalmente três tipos de ferramentas de web scraping:

- Ferramentas de autoatendimento: São ferramentas de clique e arraste que permitem aos usuários extrair dados sem programação. Elas geralmente possuem uma interface visual, onde você pode anotar os dados que deseja, e elas os extraem automaticamente para você.

- Ferramentas programáticas: São bibliotecas ou frameworks que você pode integrar ao seu código. Elas oferecem mais flexibilidade e capacidades, mas exigem conhecimento de programação.

- Serviços gerenciados: São plataformas completas onde você especifica seus requisitos, e elas entregam os dados. Elas são as mais confortáveis, mas as menos flexíveis e geralmente as mais caras.

4. Revisão Detalhada das Ferramentas de Web Scraping

Abaixo está uma revisão detalhada de algumas ferramentas de web scraping populares. Cada revisão de ferramenta inclui uma descrição de suas funcionalidades, benefícios e casos de uso.

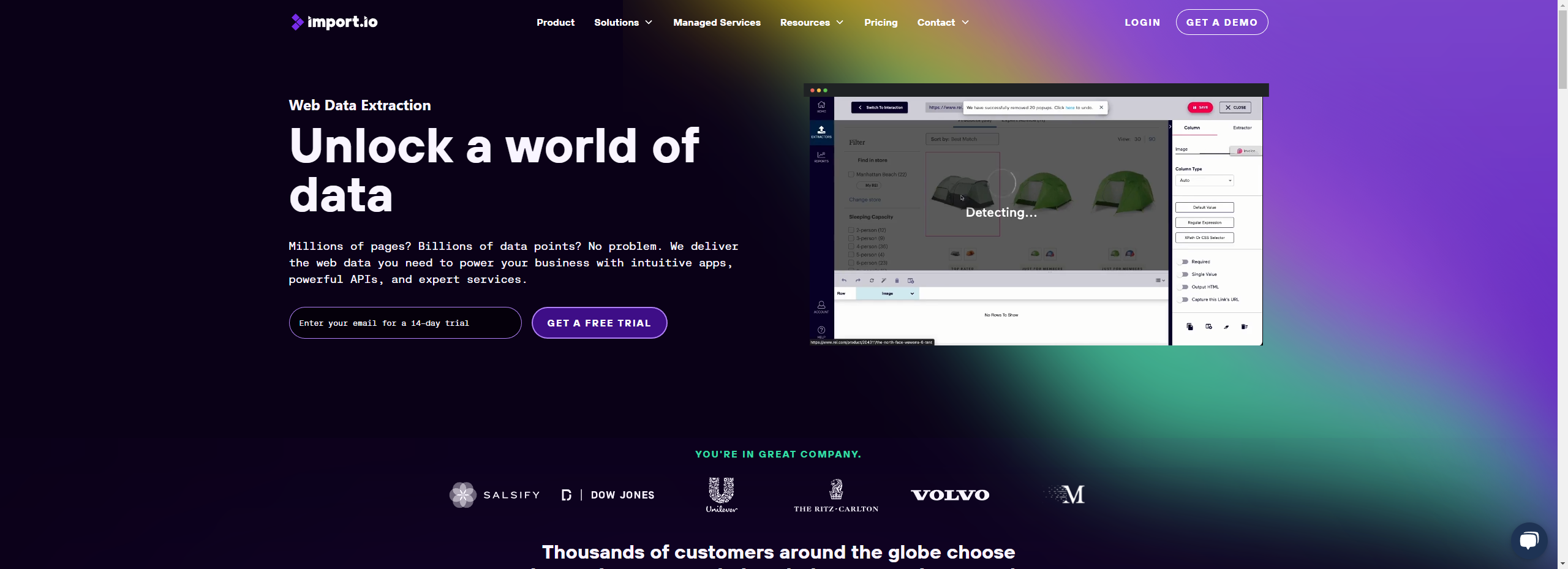

Import.io

Import.io é uma ferramenta baseada em web que extrai dados de sites sem escrever nenhum código. Ele fornece uma interface visual para apontar aos campos de dados que você deseja raspar, e depois faz o resto.

Funcionalidades:

- Interface de Clique e Arraste: Permite que os usuários identifiquem os dados necessários usando uma interface intuitiva de clique e arraste.

- Relatórios de Dados: O Import.io entrega os dados raspados como um arquivo CSV ou Microsoft Excel ou pode sincronizá-los diretamente ao seu data warehouse.

- Agendador: Pode agendar extrações de dados e sempre entrega dados atualizados.

Casos de uso:

O Import.io é perfeito para pessoas sem habilidades de programação, mas que precisam extrair dados estruturados de uma página da web. Pode ser usado para comparação de preços, análise de sentimentos, raspagem de redes sociais, etc.

Octoparse

Octoparse é uma ferramenta robusta de web scraping que automatiza a extração de dados de muitos tipos de sites. Ele possui um designer de fluxo visual que permite aos usuários gerenciar suas especificações de extração de dados.

Funcionalidades:

- Extração em Nuvem: O Octoparse oferece uma funcionalidade de extração de dados baseada em nuvem que fornece uma extração de dados de alta velocidade, já que o processo de extração é realizado em seus servidores, em vez de no dispositivo local do usuário.

- Formato de Exportação: Permite que os usuários exportem dados em vários formatos, incluindo Excel, HTML, TXT e bancos de dados (MySQL, SQL Server e Oracle).

- Acesso à API: O Octoparse fornece uma API, permitindo que os usuários manipulem seus dados remotamente.

Casos de uso:

O Octoparse pode ser usado para uma ampla gama de propósitos de extração de dados, como geração de leads, monitoramento de preços, pesquisa de mercado e pesquisa acadêmica.

ParseHub

ParseHub é uma ferramenta de extração visual de dados que qualquer pessoa pode usar para obter dados da web. Você pode configurar um plano para extrair dados de um site e deixar o ParseHub fazer o trabalho.

Funcionalidades:

- Suporte a JavaScript e AJAX: O ParseHub pode lidar com sites com JavaScript e AJAX, que são difíceis para muitos outros raspadores.

- Técnicas Avançadas: Pode lidar com dados aninhados de múltiplos níveis, paginação, listas suspensas, pesquisas e formulários.

- Agendador: Pode executar projetos de raspagem a cada 10 minutos ou uma vez por ano.

Casos de uso:

O ParseHub pode ser usado para diversos propósitos, como jornalismo de dados, crescimento de comércio eletrônico, coleta de dados para treinamento de IA e previsão de tendências de mercado.

Scrapy

Scrapy é um framework de varredura da web de código aberto escrito em Python. Ele fornece todas as ferramentas necessárias para extrair dados de sites, processá-los e armazená-los no formato preferido.

Funcionalidades:

- Versátil: O Scrapy é extremamente versátil e pode lidar com uma variedade de tarefas de raspagem, incluindo mineração de dados, processamento de dados e arquivamento histórico.

- Robusto e escalável: Foi construído para lidar com tarefas de web scraping em grande escala. Pode até mesmo lidar com tarefas de raspagem distribuídas em múltiplas máquinas.

- Bibliotecas extensas: O Scrapy possui um ecossistema e comunidade ricos, com inúmeras bibliotecas que estendem sua funcionalidade.

Casos de uso:

O Scrapy é adequado para tarefas de raspagem complexas e em grande escala. É ideal para cientistas de dados, pesquisadores e desenvolvedores que estão confortáveis com programação em Python.

BeautifulSoup

BeautifulSoup é uma biblioteca Python projetada para fins de web scraping para extrair dados de arquivos HTML e XML. É simples e acessível para iniciantes, mas sua simplicidade não compromete sua funcionalidade.

Funcionalidades:

- Análise fácil: O BeautifulSoup transforma um documento HTML complexo em uma árvore de objetos Python, como tags, strings navegáveis ou comentários.

- Pesquisa na árvore de análise: Você pode pesquisar a árvore de análise usando filtros baseados em nome da tag, atributos e mais.

- Idiomas Pythonicos: O BeautifulSoup usa idiomas Pythonicos para iterar, pesquisar e modificar a árvore de análise.

Casos de uso:

O BeautifulSoup é uma boa escolha para tarefas de web scraping que exigem análise de documentos HTML e XML. Sua simplicidade o torna uma boa escolha para iniciantes.

Selenium

Selenium é uma ferramenta poderosa para controlar um navegador web por meio de programa. É funcional para todos os navegadores, funciona em todos os principais sistemas operacionais e seus scripts são escritos em diversos idiomas, como Python, Java, C#, etc.

Funcionalidades:

- Automação de navegador: O Selenium pode automatizar tarefas de navegador, útil quando a página web é interativa e solicitações HTTP simples são insuficientes.

- Suporte a múltiplos idiomas: Os scripts do Selenium podem ser escritos em vários idiomas de programação, incluindo Python, Java e C#.

- Suporte a diversos navegadores: Ele suporta todos os principais navegadores da web, incluindo Chrome, Firefox, Safari e Edge.

Casos de uso:

O Selenium é ideal para tarefas de web scraping que exigem interação com a página da web, como clicar em botões ou preencher formulários. Também é uma boa escolha para testar aplicações web.

Puppeteer

Puppeteer é uma biblioteca Node que fornece uma API de alto nível para controlar o Chrome ou Chromium por meio do Protocolo DevTools. É frequentemente usado para web scraping, testes automatizados e geração de conteúdo pré-renderizado.

Funcionalidades:

- Navegação sem cabeça: O Puppeteer é principalmente usado em seu modo sem cabeça, oferecendo uma forma rápida e automatizada de acessar conteúdo da web.

- Interatividade: O Puppeteer pode simular interações do usuário como submissões de formulário, entradas do teclado e cliques em botões.

- Geração de capturas de tela e PDFs: O Puppeteer pode gerar capturas de tela e PDFs de páginas.

Casos de uso:

O Puppeteer é útil quando você precisa executar JavaScript em suas páginas. Pode ser usado para web scraping, testes automatizados de unidade e renderização do lado do servidor.

Cheerio

Cheerio é uma implementação rápida, flexível e leve do núcleo jQuery projetada especificamente para o servidor. É uma biblioteca Node.js que ajuda os desenvolvedores a interpretar e analisar páginas da web usando uma sintaxe semelhante ao jQuery.

Funcionalidades:

- Sintaxe jQuery: O Cheerio analisa o markup e fornece uma API para percorrer/modificar a estrutura de dados resultante.

- Desempenho: O Cheerio se concentra em uma API consistente, flexível para percorrer o DOM e realiza a análise e renderização separadamente, o que pode melhorar o desempenho.

- Flexibilidade: Funciona com uma ampla gama de documentos HTML e XML, tornando-o altamente versátil para tarefas de web scraping.

Casos de uso:

O Cheerio é uma ferramenta excelente para manipulação do lado do servidor de dados HTML, extração de dados de documentos HTML e, em particular, web scraping com Node.js.

OutWit Hub

OutWit Hub é um complemento do Firefox com dezenas de recursos de extração de dados para simplificar suas buscas na web. Esta ferramenta pode navegar automaticamente por páginas e armazenar as informações extraídas em um formato de sua escolha.

Funcionalidades:

- Extração de dados: O OutWit Hub oferece uma interface única para raspar pequenas ou grandes quantidades de dados conforme as necessidades.

- Exportação de dados: Os dados coletados com o OutWit Hub podem ser exportados como Excel, CSV, HTML ou bancos de dados SQL.

- Extração de imagens e documentos: Além de extrair dados de texto, o OutWit Hub também pode extrair imagens, arquivos PDF e mais.

Casos de uso:

O OutWit Hub é adequado para freelancers e empresas pequenas a médias que precisam extrair dados da web e armazená-los localmente.

WebHarvy

WebHarvy é um raspador visual da web com uma interface de clique e arraste para extrair dados de qualquer site facilmente. É um aplicativo de desktop com uma compra única.

Funcionalidades:

- Interface visual: O WebHarvy opera em uma interface visual que exige conhecimento mínimo de programação. Você seleciona os campos de dados a serem raspados com o mouse.

- Extração de múltiplos níveis: Ele pode seguir links para extrair dados de páginas detalhadas e também pode lidar automaticamente com paginação.

- Suporte a Expressões Regulares: O WebHarvy suporta Expressões Regulares (RegEx) que podem ser usadas para corresponder a padrões durante a extração de dados.

Casos de uso:

O WebHarvy é ideal para não programadores que precisam extrair dados periodicamente de sites específicos para um arquivo Excel ou CSV.

DataMiner

Data Miner é uma extensão de navegador pessoal que ajuda você a transformar dados HTML em janelas do navegador em conjuntos de dados limpos e estruturados.

Funcionalidades:

- Extratores de dados prontos: O Data Miner usa extratores de dados pré-preparados submetidos pela comunidade para extrair dados de sites populares.

- Criação de receitas: Você também pode criar suas próprias receitas de extração de dados usando o Data Miner.

- Exportação de dados: O Data Miner permite exportar dados nos formatos CSV ou JSON.

Casos de uso:

O Minador de Dados é útil para profissionais que precisam coletar uma quantidade moderada de dados de sites específicos e economizar tempo na entrada ou extração de dados.

Mozenda

O Mozenda é um software de raspagem web para empresas projetado para atender a diversas necessidades de extração de dados. Ele possui uma interface amigável, com um sistema de clique e arraste, e oferece flexibilidade para coletar uma ampla gama de tipos de dados.

Recursos:

- Interface de Clique e Arraste: O Mozenda permite aos usuários selecionar facilmente os dados necessários usando uma ferramenta de clique e arraste.

- Plataforma em Nuvem: O Mozenda opera como um raspador web baseado em nuvem, oferecendo extração de dados de alta velocidade.

- Acesso à API: O Mozenda fornece uma API, permitindo que os usuários integrem seus dados em outros aplicativos.

Casos de uso:

O Mozenda é ideal para empresas e pesquisadores que precisam extrair uma ampla gama de tipos de dados, incluindo textos, imagens, documentos e mais, de vários sites.

5. Conclusão

Ferramentas de raspagem web são essenciais no mundo orientado por dados de hoje. Desde entender o sentimento dos clientes até monitorar concorrentes, os usos da raspagem web são infinitos. No entanto, nem todas as ferramentas de raspagem web são criadas iguais. A ferramenta certa para você depende de sua experiência técnica, da complexidade da tarefa e do tipo de dados que você precisa coletar.

Se você é um iniciante ou alguém que prefere não programar, ferramentas como Import.io, Octoparse, ParseHub, WebHarvy e OutWit Hub seriam mais adequadas. Por outro lado, se você estiver confortável com programação, pode usar ferramentas mais flexíveis e poderosas como Scrapy, BeautifulSoup, Selenium, Puppeteer e Cheerio.

Independentemente da ferramenta que escolher, lembre-se sempre de respeitar os termos de serviço do site e usar os dados de forma responsável.

Perguntas Frequentes

1. Qual é a melhor ferramenta de raspagem para iniciantes?

Para iniciantes ou usuários não técnicos, ferramentas visuais e sem código, como Import.io, Octoparse, ParseHub, WebHarvy e OutWit Hub, são as melhores opções. Elas oferecem interfaces de clique e arraste, agendamento integrado e exportação de dados fácil, sem exigir conhecimento de programação.

2. Quando devo usar o Selenium ou o Puppeteer em vez de raspadores tradicionais?

O Selenium e o Puppeteer são ideais para sites que dependem for de JavaScript, carregamento de conteúdo dinâmico ou interações do usuário, como clicar em botões, preencher formulários ou rolar infinitamente. Raspadores tradicionais baseados em HTTP podem falhar nesses cenários.

3. A raspagem web é legal?

A raspagem web não é intrinsecamente ilegal, mas sua legalidade depende de como e onde é usada. Fatores como os termos de serviço do site, o tipo de dados coletados e as regulamentações locais de proteção de dados importam. É essencial raspar de forma responsável, evitar dados protegidos ou pessoais e garantir conform

the compliance com leis e políticas relevantes.

Ver mais

web scrapingApr 22, 2026

Arquitetura de Web Scraping em Rust para Extração de Dados Escalável

Aprenda arquitetura de raspagem web escalável em Rust com reqwest, scraper, raspagem assíncrona, raspagem de navegador headless, rotação de proxies e tratamento de CAPTCHA compatível.

web scrapingApr 08, 2026

Selenium vs Puppeteer para Resolução de CAPTCHA: Comparação de Desempenho e Caso de Uso

Compare o Selenium vs Puppeteer para resolver CAPTCHA. Descubra benchmarks de desempenho, notas de estabilidade e como integrar o CapSolver para o máximo de sucesso.